Hoe weet je of dit bericht geen fake is? En of die hele VOGIN-IP-lezing wellicht een hoax is? Waarschijnlijk omdat je ons vertrouwt. En waarschijnlijk omdat je digitaal geletterd bent. En belangrijker nog: die geletterdheid is waarschijnlijk ook niet alleen digitaal.

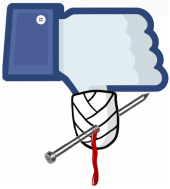

Maar kennelijk is dat niet voor iedereen zo makkelijk, als we de recente discussies over fake-nieuws volgen, die rond de Amerikaanse presidentsverkiezingen in een geweldige stroomversnelling zijn geraakt. De hoaxes en fake berichten die op Facebook (Fakebook?) gedeeld werden of in Google een hoge ranking kregen, hebben misschien wel bijgedragen aan de uiteindelijke verkiezingsuitslag.

De hoaxes en fake berichten die op Facebook (Fakebook?) gedeeld werden of in Google een hoge ranking kregen, hebben misschien wel bijgedragen aan de uiteindelijke verkiezingsuitslag.  Het maken van dergelijke fake-berichten blijkt zelfs een heuse industrietak te zijn geworden.

Het maken van dergelijke fake-berichten blijkt zelfs een heuse industrietak te zijn geworden.

Het zou daarom mooi zijn als betrouwbare informatie een stempeltje ”niet fake” zou kunnen krijgen. Zelfs Facebook en Google willen dat intussen wel. Maar het is een beetje te veel om dat allemaal door mensen te laten doen. Nu iedereen het over machine learning heeft, kunnen we een computer misschien wel leren dat voor ons te doen. Dat is nu precies waarmee Srijan Kumar bezig geweest is. Hij heeft onderzocht waaraan hoaxes die in de Wikipedia terecht gekomen zijn, herkend kunnen worden. Dat is nog niet het hele internet en heel wat minder dan alle nieuwtjes op Facebook, maar het is wel al een aardige stap in een mogelijke richting om automatisch onzin te laten herkennen.

We zijn dan ook blij dat Srijan ons op 9 maart daar het een en ander over komt vertellen in zijn lezing: “Disinformation on the Web: Impact, Characteristics, and Detection of Wikipedia Hoaxes”.

[Zie ook deze PDF.]

En die geolocation techniek is ook precies een van de dingen waar Christiaan Triebert, een Nederlands lid van dat Bellingcat collectief, ons op 9 maart over komt vertellen. Hij laat dan wat meer zien van de diverse methoden die Bellingcat toepast, met gebruikmaking van open bronnen en vrij beschikbare tools.

En die geolocation techniek is ook precies een van de dingen waar Christiaan Triebert, een Nederlands lid van dat Bellingcat collectief, ons op 9 maart over komt vertellen. Hij laat dan wat meer zien van de diverse methoden die Bellingcat toepast, met gebruikmaking van open bronnen en vrij beschikbare tools.

Volgens de Wikipedia zou je Joyce van Aalten geen

Volgens de Wikipedia zou je Joyce van Aalten geen

En denk meer recent aan het Memento protocol dat zijn groep ontwikkeld heeft om moeiteloos en geheel transparant oude versies van webpagina’s uit webarchieven te kunnen ophalen, waarmee bijvoorbeeld link- of reference-rot kan worden tegengegaan.

En denk meer recent aan het Memento protocol dat zijn groep ontwikkeld heeft om moeiteloos en geheel transparant oude versies van webpagina’s uit webarchieven te kunnen ophalen, waarmee bijvoorbeeld link- of reference-rot kan worden tegengegaan.